导语

用AI把自己送进了ICU

70美元,或者说495元能买到什么?

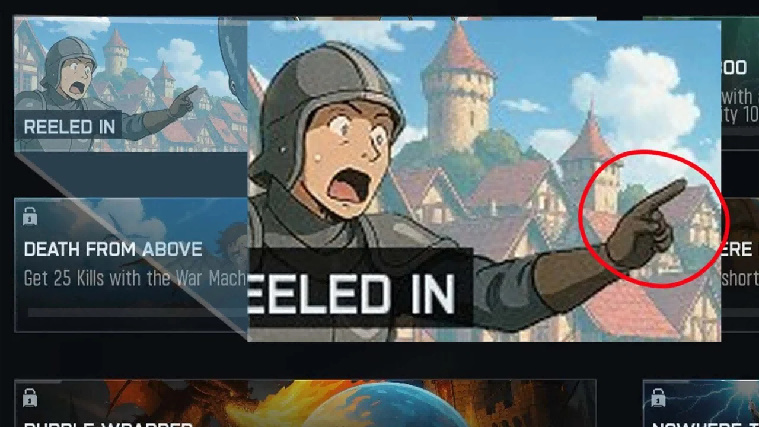

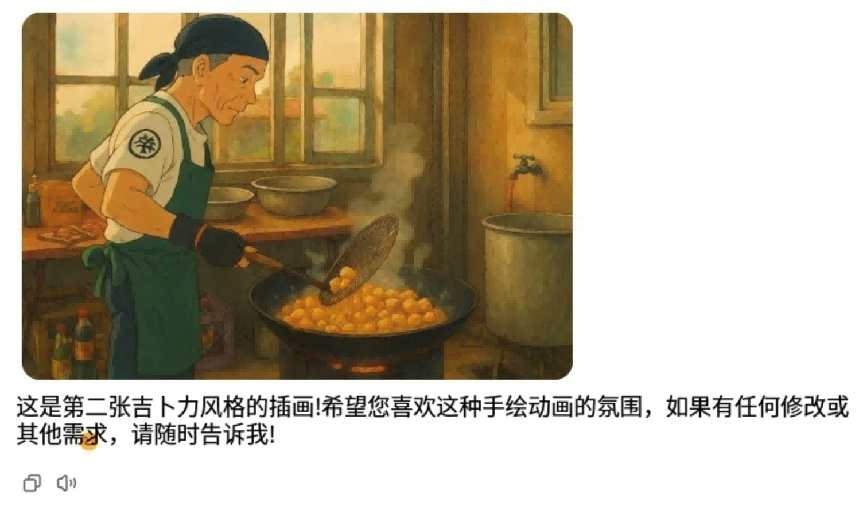

在2025年的游戏市场,这个问题在近期发售的《使命召唤:黑色行动7》中有了一个答案:680张以上的称号卡,其中一部分长着六根手指、画风形似吉卜力的那些动画。

《使命召唤:黑色行动7》上线后,玩家们很快发现了端倪。那些本该彰显身份的称号卡和武器皮肤,充斥着AI生成的典型错误。

作为该系列首个登上涨价版XGP的重磅作品,微软本寄希望于用它来平息用户对订阅费用上涨的不满,然而发售前曝光的战役模式中的站桩BOSS让一切开始土崩瓦解。

以上种种,被堂而皇之地塞进了一款售价70美元的3A大作里,还成了付费内容的一部分。

玩家的愤怒很快转化成了行动。Metacritic的用户评分被砸到了截止撰稿时的1.6分,创下了《使命召唤》系列有史以来的最低纪录。

“我花了70美元,结果买到的是AI生成的垃圾。”

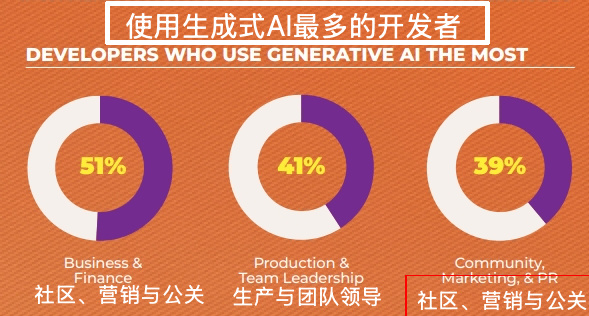

在今年初,游戏开发者大会(GDC)发布了一项调查报告,对已经部署生成式AI工具的岗位比例给出了一个数字:51%的是商务和财务;41%的是制作组和团队领导;39%的是社区、营销和PR。这意味着你玩的每10款新游戏里,就有3-5款可能在某个环节用上了AI,只是你不一定知道而已。

来源:GDC 2025 State of the Game Industry Report

但知情权只是问题的起点。育碧的《纪元117:罗马和平》老老实实在Steam页面标注“AI辅助创作”,结果好评率只有67%,玩家照样骂。为什么?因为“用了AI”这四个字,回答不了玩家真正关心的问题:哪里用了?用了多少?质量过关吗?

《纪元117:罗马和平》截图

就像你去餐厅吃饭,菜单上只写“本菜使用添加剂”,然后,是防腐剂还是增味剂?符合标准吗?只丢一个模糊的标签给你就不是真正的透明。

玩家付出真金白银,他们期待的是人类创作者的心血,而不是算法批量生产的“预制菜”。

当然,AI看似能干所有事,但也不能什么责任都推给AI,在《使命召唤:黑色行动7》的差评里,还有因为该作的战役模式要求全程联网,导致即便是单人剧情,玩家也无法暂停游戏;更荒谬的是,游戏甚至会在推送更新期间强制中断战役进程。

而如果我们把视线从动视暴雪的狼狈中移开,会发现一个更值得玩味的现象。

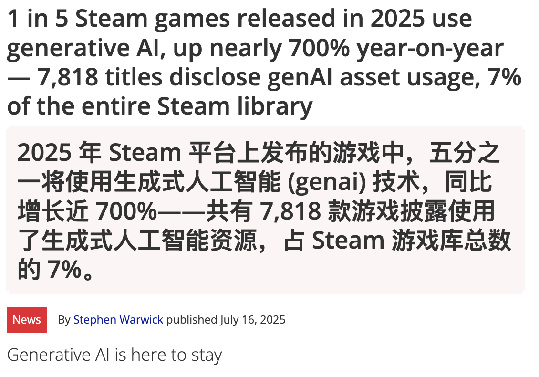

就在《使命召唤》被骂的同一时期,Steam上标注AI使用的新游戏数量同比暴涨了700%,米哈游大大方方地发布了要求掌握Midjourney、Stable Diffusion的招聘启事,网易旗下的逆水寒和燕云十六声则把AI动捕做成了玩家津津乐道的社区话题。

同样是用AI,有的被钉上耻辱柱,有的却成了“正面教材”。

这场看似关于“AI质量”的争议,本质上是玩家、开发商、乃至整个行业终于要正面回答那个被回避已久的问题。

AI在游戏里,到底应该怎么用?

01

从幕后走到前台

其实AI进入游戏行业并不是什么新鲜事。

早在2017年,网易雷火就成立了伏羲AI实验室,同年网易互娱也组建了自己的AI Lab。腾讯的AI Lab更是在2016年就已运作。彼时AI更多扮演着“幕后工具人”的角色——帮策划调数值、给美术生成参考图、替QA跑自动化测试,玩家几乎感知不到它的存在。

转折发生在2022年。

那一年,Stable Diffusion开源,Midjourney爆火,ChatGPT横空出世。生成式AI的能力边界被彻底打开,游戏行业的态度也从悄悄用变成了大声喊。

Steam带有AI标注的游戏数量同比暴涨超过700%的数字背后,是无数团队把AI当成了降本增效的救命稻草,也是部分大厂试图用AI重构生产管线的野心。

而这其中,米哈游的动作尤其值得关注。

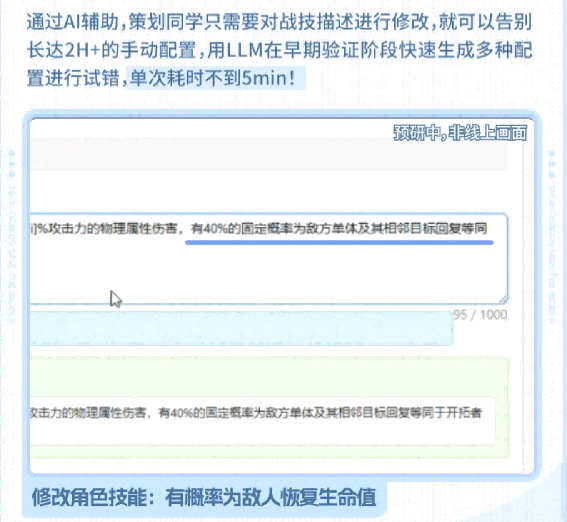

今年他们在官方招聘公告里,罕见地公开了AI在内部的应用场景:程序方面,大语言模型能帮策划把“修改技能数值”这种活从2小时压缩到5分钟;美术方面,AI可以直接生成3D模型、批量修改材质;甚至招聘要求里明确写着“熟练使用Midjourney、Stable Diffusion”。

网易这边,不仅内部用,还要让玩家也用起来。

《逆水寒》背靠雷火伏羲实验室,把“能呼吸的AI NPC”做成了产品卖点,号称节约了80%的动画制作时间。《燕云十六声》则背靠互娱AI Lab,走了一条更讨巧的路:用AI NPC攻略制造社区话题,单条内容就收获了1.38亿曝光和114万互动;再用“太极万物”平台让玩家自己生成3D模型,一周产出4.5万件UGC内容。

有意思的是,这两个项目分属网易不同事业群,技术互不相通,各自赛马。这场内部竞争的结果,是AI从幕后走向前台的速度被大大加快。

当头部厂商纷纷把AI摆上牌桌,行业的潘多拉魔盒就此打开。

02

三种路径,三种命运

同样是用AI,为什么有人翻车有人出圈?拆解开来看,答案就藏在细节里。

《使命召唤:黑色行动7》的问题,不只是AI本身。

680多张称号卡的低质量贴图,这在3A游戏里确实罕见,因为连非开发人员都清楚,这种图片可是GPT-4o靠“吉卜力画风”出圈的早期阶段了。

但真正点燃玩家怒火的,是动视的态度。

首先是不透明。游戏发售前,官方从未主动披露AI参与了哪些环节、占比多少、质量如何把控。玩家是在看到那些六指怪手和融化的人脸之后,才意识到自己70美元买的是“AI预制菜”。

其次是低质量。称号卡这种边缘内容用AI生成,本身没什么问题。但连基础的质检都过不了,五根手指都数不清楚,这就不是AI的锅,而是项目管理的锅。它暴露出的是动视在使用AI时缺乏严格的质量门槛。

或者说,根本没把玩家当回事。

这让人想起2021年的一桩公案。那年《宝可梦:钻石/珍珠》成为系列首款完全外包的作品,交给ILCA公司制作。结果二头身建模僵硬得像扭蛋玩具,Bug多到可以复制神兽,IGN日本直接给出5分。

当年玩家骂的是什么?“Game Freak为了省钱找外包,质量根本不过关。”现在玩家骂的又是什么?“动视为了省钱用AI,质量根本不过关。”

连台词都没怎么变,只是外包换成了AI。

工具从来不是原罪,滥用才是。外包做得好,可以成就《地平线:零之曙光》这样18家公司协作的视觉奇迹;做得差,就是宝可梦的翻车现场。AI也是一样,用得好是生产力革命,用得差就是偷工减料的遮羞布。

事件发酵后,动视的回应堪称公关灾难。既没有正面道歉,也没有给出补救方案,只是轻描淡写地表示“会在后续更新中处理”。这种态度彻底激怒了社区,Metacritic、Reddit上的声讨帖子至今还挂在热门。

动视这个案例的教训很清晰,AI不是挡箭牌,该背的锅一个都跑不掉。用AI降本可以,但降到连基本质量都保不住,那就是在透支品牌信誉。

因此,不论《燕云十六声》还是《逆水寒》,都可以发现他们的AI在走一条更为务实的AI路线。

如果说动视网易给出了正反面例子,那Embark Studios的《Arc Raiders》就是一个更复杂的灰色样本。

这款游戏在今年6月上线Steam,首周就冲到了峰值48万同时在线。但很快玩家发现,游戏里大量NPC的配音听起来“怪怪的”,语调平淡、情感缺失、断句诡异。明显是AI生成的配音。

Embark Studios的回应很坦诚:是的,我们用真人采样+AI的语音合成技术,但这是为了在Early Access阶段快速迭代,正式版会替换成真人配音。

这个案例引出了一个核心讨论:“功能性AI”和“创意性AI”的边界到底在哪?

AI用于语音合成、动作捕捉、程序化地图生成这类重复性技术工作,玩家接受度明显更高。但AI一旦染指角色美术、剧情文本、核心玩法设计这些需要“灵魂”的创意领域,抵触情绪就会爆发。

《黑色行动7》的失败不只是因为用了AI,更是因为把AI用在了最不该用的视觉资产上。而Arc Raiders虽然被Eurogamer打了2/5分,但48万的峰值在线(以及环大陆好评)证明了一件事:只要核心玩法够硬,玩家是可以原谅功能性AI使用的。

边界不在用不用,而在用哪里。

AI使用的边界,最终可能不是由伦理或审美决定的,而是由市场反馈决定的。只要玩家还在玩、还在付费,厂商就有继续使用AI的动力。反过来说,只有当AI真正影响到玩家的购买决策时,厂商才会认真对待这个问题。

这就引出了一个更深层的困境。

03

十字路口

站在2025年末回望,游戏行业的AI应用正处于一个尴尬的“伦理真空期”。

没有行业标准规定AI必须披露到什么程度。Steam的标注政策是目前接近规范的尝试,但它只要求开发者勾选“是否使用AI”,不要求说明使用范围、占比、质量把控流程。这就导致了一个荒诞的局面。

一款只用AI生成了几张概念图的独立游戏,和一款80%内容都是AI产出的商业作品,在标注上可能完全一样。

《使命召唤:黑色行动7》的AI使用声明

没有玩家共识决定AI的使用边界在哪里。用AI调数值,绝大多数人不会有意见;用AI生成NPC对话,部分人能接受;用AI画立绘、做配音、写剧情,争议就开始变大;用AI替代核心创意,比如关卡设计、角色塑造、叙事架构,那几乎是众怒。但这些边界是模糊的、动态的,因游戏类型和玩家群体而异。

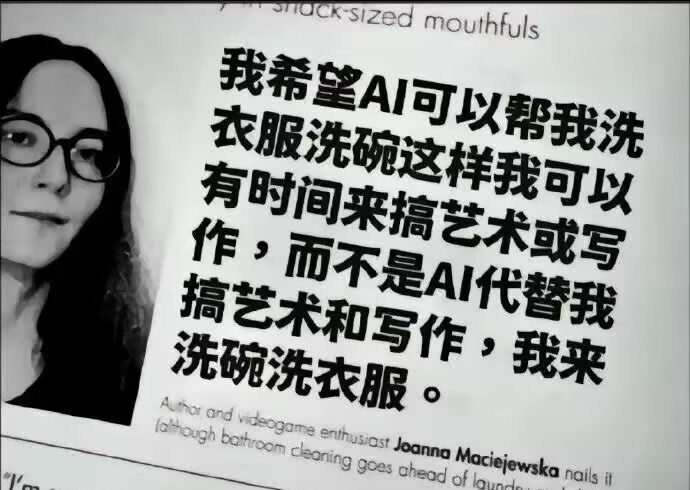

有趣之处在于,人们用AI不代表就完全拥抱AI。

法律监管更是远远滞后于技术迭代的速度。美国国会议员Ro Khanna刚开始介入COD事件,欧盟的数字服务法还在研究怎么约束游戏AI。版权问题悬而未决,AI训练数据从哪来?有没有侵犯原画师权益?至今没有明确答案。

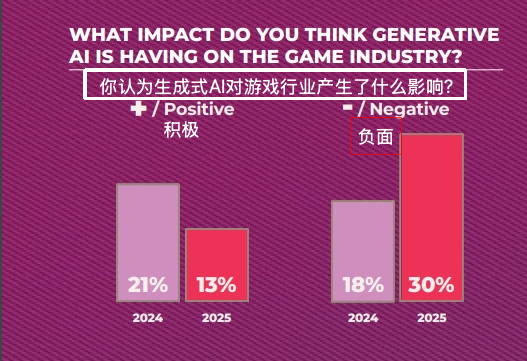

早在今年初游戏开发者大会(GDC)发布的年度调查就显示,30%的开发者认为AI对行业有负面影响,但到底负面在哪?怎么规避?没人说得清。Steam的AI披露标签也只是个“有或没有”的二元选择,至于披露到什么程度、用得是否合规,全看制作游戏链条上的Prompt是怎么说的。

米哈游一边在招聘公告里大张旗鼓地展示AI应用场景,要求美术岗位必须会用Midjourney;一边在《崩坏:星穹铁道》翁法罗斯的剧情里,安排一出“讽刺AI”的戏码。

这种分裂不一定是虚伪,更可能是真实的纠结——他们知道AI是效率工具,但也知道自家玩家最看重的是“人味”和“匠心”。

就在《使命召唤》因AI翻车的同一季度,腾讯的Q3财报释放了一个有意思的信号。

这家中国最大的游戏公司,资本开支同比下降24%、环比下降32%,全年指引从年初的“low teens增长”下调至“高于2024年”。高管在电话会上明确表示:AI战略的核心不是砸钱堆算力,而是“以更低成本实现更强性能对核心业务增益”。翻译成人话就是——我们不跟风烧钱,要看到实际回报才会加码。

在见证了太多“AI画饼、资本买单、玩家遭殃”的案例之后,不得不说这是一种理性选择。毕竟,隔壁Meta每个季度往AI基建里砸上百亿美元,至今还在向投资人解释“为什么还没看到回报”。

说到底,AI在游戏里到底应该怎么用,这个问题没有标准答案,但有一条铁律:

玩家会用钱包投票。

《使命召唤:黑色行动7》英国首周销量暴跌61%,Steam同时在线峰值相比前作下降了68%。这个数字比任何行业报告都有说服力。当玩家觉得自己被“AI预制菜”糊弄了,他们会毫不犹豫地转身离开。哪怕这是一个年货系列,哪怕这是一个3A大作。

反过来,《逆水寒》《燕云十六声》《ARC Raiders》的案例也证明当AI被包装成玩家体验而不是成本缩减,当玩家自己成为AI的使用者而不是被替代者,抵触情绪是可以化解的。

这两条路径,或许就是整个行业在AI时代的十字路口。

一条路通向“替代”,用AI取代人类创作者,压低成本,提高产能,把游戏变成流水线上的工业品。这条路走到底,可能会生产出大量“能玩但没有灵魂”的产品,然后在某个临界点引发玩家的集体反噬。

另一条路通向“工具”,让AI成为创作者的放大器,而不是替代品。用AI处理重复劳动、加速迭代周期、赋能玩家创作,但核心创意和情感表达依然由人类把控。这条路更难走,因为它要求厂商在效率和品质之间找到平衡,而不是一味追求前者。

《使命召唤:黑色行动7》的翻车,是因为越来越多的玩家开始在意这个游戏里有多少是AI生成,这个问题开始影响购买决策,行业不得不认真面对一个根本性的追问。

游戏卖的到底是什么?是内容本身,还是内容背后的人?

这个问题的答案,最终会由玩家的钱包来揭晓。

更多游戏资讯请关注:电玩帮游戏资讯专区

电玩帮图文攻略 www.vgover.com